真实到令人颤栗:Sora开辟AI生成视频新纪元

发布时间:2024-03-05 17:59:27 浏览量:138次

2月16日,Open AI公司发布了一款能够根据文字提示生成视频的人工智能工具——Sora。

这段时长60秒左右的视频展示了小狗雪地嬉戏直视镜头、无人机视角下东京的雪景和海浪冲击大苏尔悬崖、笑容满面的老奶奶享受生日派对等多个场景画面。

Sora视频生成技术不仅能够复制现实中的场景,还能够创造出我们现实中并不存在但在感觉上又非常真实的画面。

其实,在过去一年中人工智能生成的图像、音频和视频的质量已经得到迅速提高。OpenAI、谷歌、Meta、Stable Diffusion等众多公司竞相开发更先进、更容易使用的工具,目前大多数模型生成视频只有几秒钟的时长。

但是,Sora显然更为出众。它不仅能够生成长达60秒的高清视频,而且能更好地组合三维世界物体。这种技术不仅能够复制现有的场景,还能够创造出我们从未见过的、但感觉上又非常真实的画面。用OpenAI自己的话来说:“Sora能够生成具有多个角色、特定类型的动作、准确主题和丰富背景细节的复杂场景。”

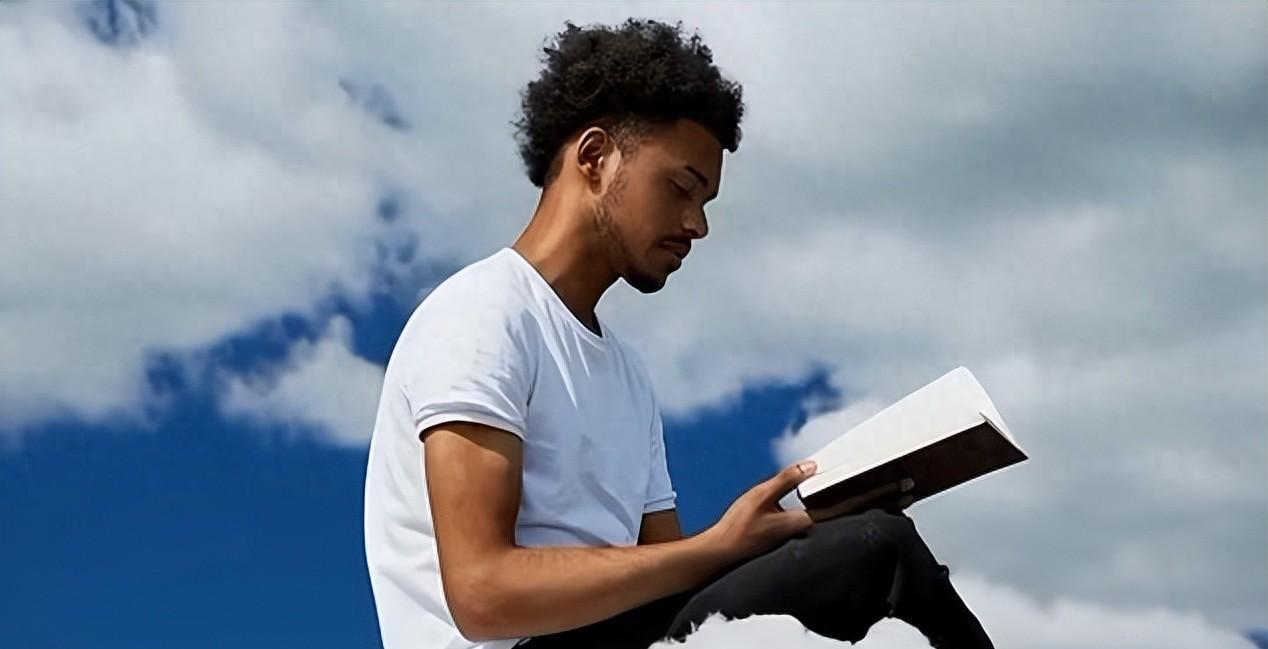

Sora 生成图片 20岁少年坐在云朵上阅读

专家称这是一项具有颠覆性的技术。

目前,OpenAI 尚未发布有关 Sora 的详细技术报告,也未解释或证明该模型如何有效。

据《麻省理工科技评论》人工智能栏目高级编辑威尔·道格拉斯·海文的文章介绍,Sora 结合了扩散模型与 Transformer 神经网络技术。

扩散模型背后的直觉来源于物理学。在物理学中气体分子从高浓度区域扩散到低浓度区域,这与由于噪声的干扰而导致的信息丢失是相似的。所以通过引入噪声,然后尝试通过去噪来生成图像。在一段时间内通过多次迭代,模型每次在给定一些噪声输入的情况下学习生成新图像。

Transformer 是 OpenAI GPT-4和谷歌 Gemini 等大型语言模型中的灵魂。它非常擅长处理长序列的数据,比如单词,但是视频不是由文字构成的。因此,研究人员想到办法在空间和时间上将视频分割成数据块,然后让 Transformer 像处理文本块中的单词那样处理这些视频数据块。采用这种方式使得用来训练 Sora 的视频类型更为丰富。

尽管如此,OpenAI表示Sora仍存在明显的“弱点”,特别是在空间细节方面,如分不清左右方向以及因果关系。举一个例子,生成的一个视频中有人咬了一口饼干,但之后并没有咬痕。

Sora技术的未来发展充满了无限的可能性。

在娱乐产业,它可以用于创造更加逼真的电影、游戏和虚拟现实体验。在教育领域,Sora技术可以用来模拟复杂的科学实验或历史事件,帮助学生更好地理解和学习。此外,它在医疗、军事等领域也有着广泛的应用前景。

但短期内,预计配音演员、游戏、教育、广告制作、短视频制作领域将会受到最大的冲击。

人工智能技术角逐背后最大的赢家

英伟达显然已成为人工智能计算芯片领域的领袖。在过去的12个月里,这家总部位于加州的公司股价上涨了246%。上周,英伟达股价一度收于每股781.28美元,市值达到1.78万亿美元。比亚马逊的1.75万亿美元市值还要高。

据报道,这是自2002年以来,英伟达的市值首次在收盘后超过亚马逊。

热门资讯

-

想将照片变成漫画效果?这篇文章分享了4个方法,包括Photoshop、聪明灵犀、VanceAI Toongineer、醒图,简单操作就能实现,快来尝试一下吧!

-

2. 华为手机神奇“AI修图”功能,一键消除衣服!原图变身大V领深V!

最近华为手机Pura70推出的“AI修图”功能引发热议,通过简单操作可以让照片中的人物换装。想了解更多这款神奇功能的使用方法吗?点击查看!

-

3. AI视频制作神器Viggle:让静态人物动起来,创意无限!

Viggle AI是一款免费制作视频的AI工具,能让静态人物图片动起来,快来了解Viggle AI的功能和优势吧!

-

近年来,人工智能逐渐走入公众视野,其中的AI图像生成技术尤为引人注目。只需在特定软件中输入关键词描述语以及上传参考图就能智能高效生成符合要求的...

-

5. AI显卡绘画排行榜:4090无悬念,最具性价比出人意料

在AI绘图领域,Stable Diffusion的显卡绘图性能备受关注。本文整理了Stable Diffusion显卡的硬件要求和性能表现,以及2023年3月显卡AI绘图效率排行榜和性价比排行榜。欢迎查看最新的AI显卡算力排行榜。

-

6. Logo Diffusion——基于sd绘画模型的AI LOGO 生成器

这下LOGO设计彻底不用求人了。接下来详细演示一遍操作流程首先进入Logo D... 想学习更多AI技能,比如说关于怎么样利用AI来提高生产效率、还能做什么AI...

-

7. 零基础10分钟生成漫画,教大家如何用AI生成自己的漫画

接下来,我将亲自引导你,使用AI工具,创作一本既有趣又能带来盈利的漫画。我们将一起探索如何利用这个工具,发挥你的创意,制作出令人惊叹的漫画作品。让...

-

就能快速生成一幅极具艺术效果的作品,让现实中不懂绘画的人也能参与其中创作!真的超赞哒~趣趣分享几款超厉害的AI绘画软件,提供详细操作!有需要的快来...

-

9. 10个建筑AI工具,从设计到施工全覆盖!肯定有你从来没听过的

讲述了建筑业比较著名的AI公司小库科技做出的探索,在这儿就不多说了。今天,我们试着在规划设计、建筑方案设计、住宅设计、管道设计、出渲染图、3D扫...

-

以下是一些免费的AI视频制作网站或工具,帮助您制作各种类型的视频。 1. Lumen5:Lumen5是一个基于AI的视频制作工具,可将文本转换为视频。 用户可以使...

最新文章

火星网校

火星网校